.png)

Estado de la IA en Seguridad y Desarrollo

Nuestro nuevo informe recoge las voces de 450 líderes de seguridad (CISOs o equivalentes), desarrolladores e ingenieros de AppSec en toda Europa y EE. UU. Juntos, revelan cómo la IA en ciberseguridad y desarrollo de software ya está causando problemas, cómo la proliferación de herramientas está empeorando la seguridad y cómo la experiencia del desarrollador está directamente ligada a las tasas de incidentes. Aquí es donde la velocidad y la seguridad chocan en 2026.

Hallazgos clave

.jpg)

Adopción de IA

1 de cada 5 sufrió un incidente grave vinculado a código de IA

.png)

“Mientras las organizaciones luchan por aprovechar los beneficios de la IA, a menudo hay una batalla oculta asociada en curso, y es la de mantener su organización a salvo de un aumento del riesgo cibernético que presenta la IA. El papel del CISO es asegurar que la postura de seguridad escale tan rápido como lo hace la tecnología.”

El 53% culpa al equipo de seguridad por incidentes relacionados con código de IA

“Claramente hay una falta de claridad entre los encuestados sobre dónde debería recaer la responsabilidad de una buena gestión de riesgos”

.png)

Experiencia del desarrollador

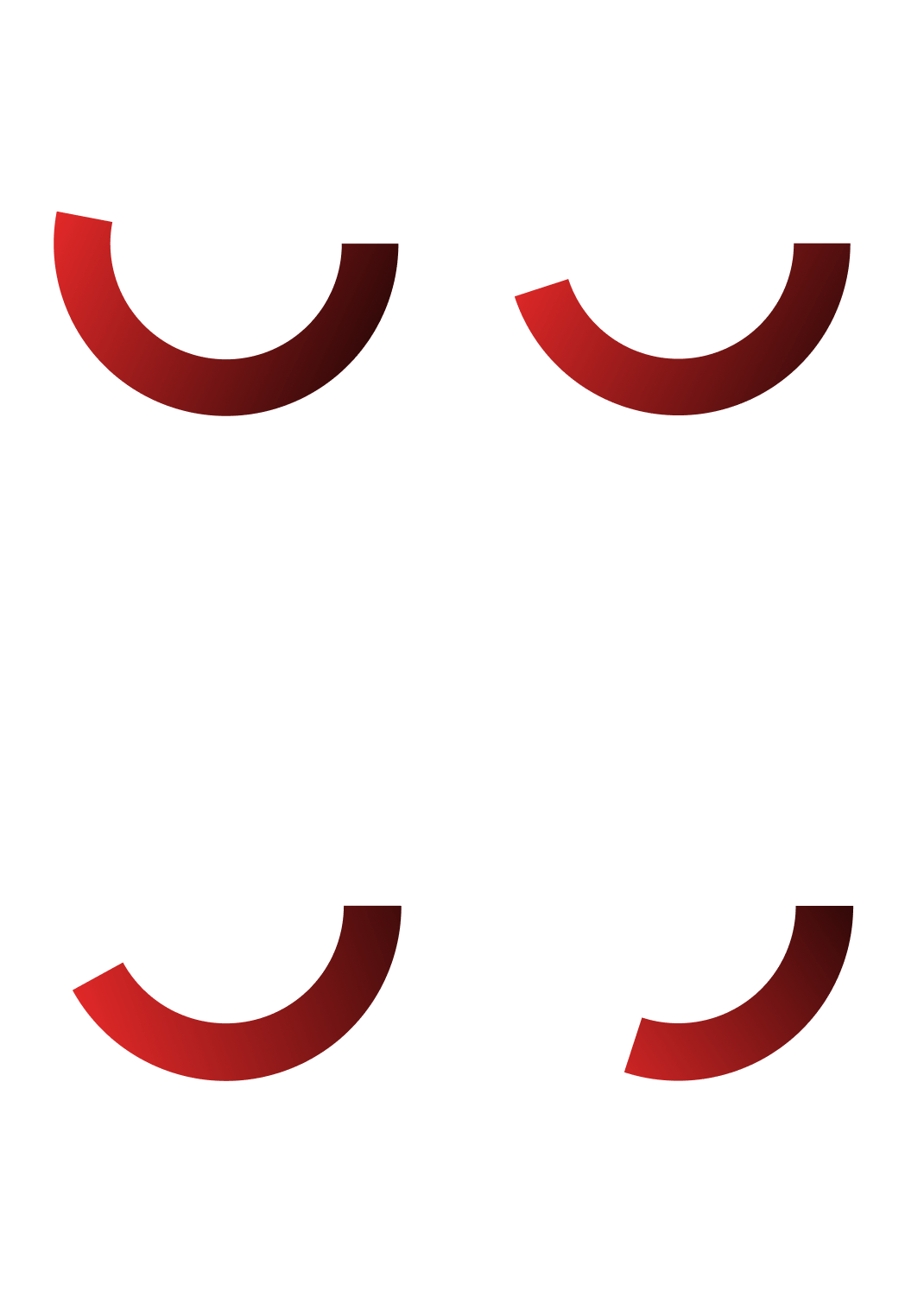

15%

del tiempo de ingeniería se pierde en triar alertas

Eso son 20 millones de dólares al año para una organización de 1000 desarrolladores

Coste anual estimado del tiempo de los desarrolladores dedicado al triaje

.png)

2/3 de los encuestados eluden la seguridad, descartan los hallazgos o retrasan las correcciones

.png)

“Cuando las herramientas de seguridad abruman a los desarrolladores con ruido, estos recurren a soluciones alternativas arriesgadas. Nuestro objetivo es restaurar el equilibrio eliminando los falsos positivos, reforzando las barreras de seguridad y mejorando la experiencia del desarrollador, para que los equipos puedan centrarse en lo que realmente importa.”

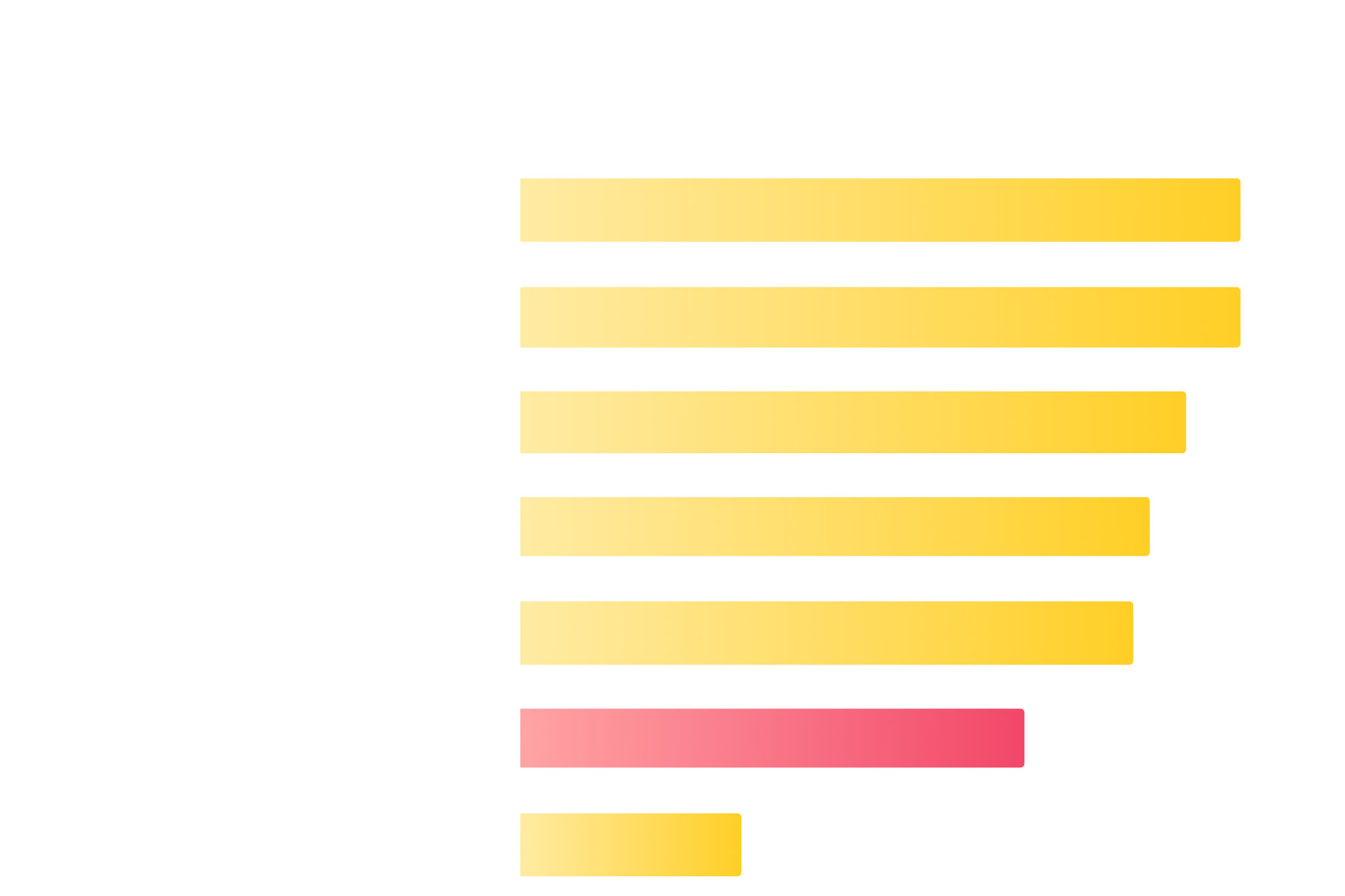

Las herramientas diseñadas tanto para equipos de desarrollo como de seguridad registraron muchos menos incidentes

Los equipos que utilizan herramientas diseñadas tanto para desarrolladores como para equipos de seguridad tienen más del doble de probabilidades de reportar cero incidentes en comparación con aquellos que usan herramientas creadas para un solo grupo.

.png)

“Proporcionar a los desarrolladores la herramienta de seguridad adecuada que funciona con las herramientas y flujos de trabajo existentes, permite a los equipos implementar las mejores prácticas de seguridad y mejorar su postura.”

.jpg)

Realidad de la seguridad

Es un tanto irónico que la industria hable tanto de reemplazar a las personas con IA, pero en seguridad, nos preocupa mucho más no disponer de suficiente personal de seguridad.

.jpg)

Los equipos que utilizan herramientas de AppSec y CloudSec separadas tienen un 50% más de probabilidades de enfrentar incidentes.

.png)

"Está claro que necesitamos combinar nuestros programas de AppSec y seguridad en la nube en un único equipo de seguridad de producto. Para las empresas donde la infraestructura se define como código, la seguridad en la nube es fundamentalmente seguridad del código, y esto impulsa mejores resultados."

El futuro de la IA

El 96% cree que la IA escribirá código seguro y fiable

9 de cada 10 organizaciones esperan que la IA asuma las pruebas de penetración, con un plazo medio de 5,5 años.

.png)

.png)

.svg)